18 min

18 min

Riflessioni sull’Intelligenza Artificiale (IA)

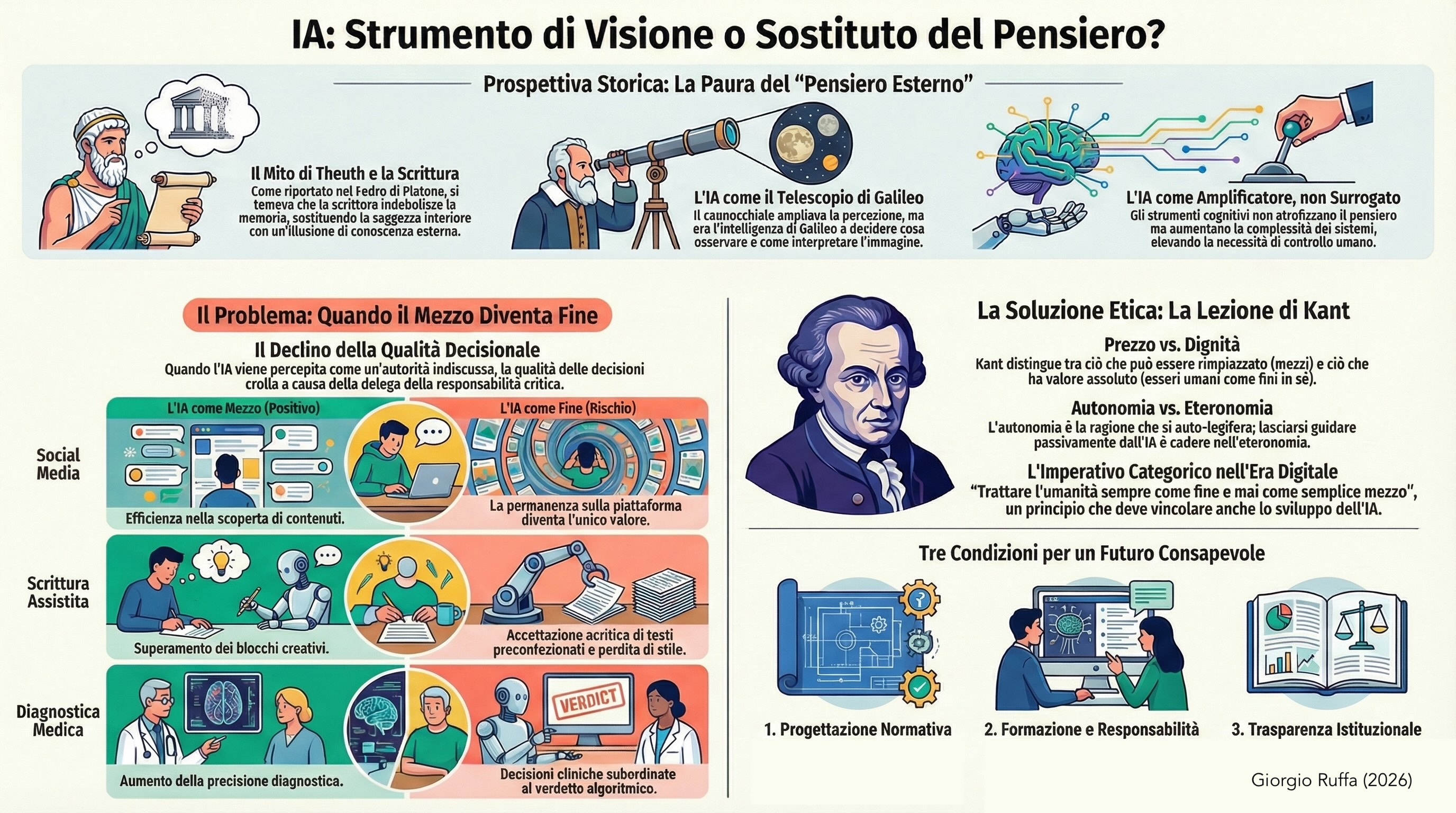

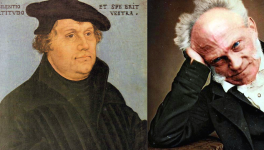

Dal mio punto di vista, nonostante vi siano accese discussioni e diffuse preoccupazioni, l’Intelligenza Artificiale (IA) è uno strumento di notevole utilità. Storicamente, ogni qualvolta l’umanità ha sviluppato uno strumento cognitivo, si sono manifestati timori riguardo alla sua potenziale capacità di “pensare al posto nostro”. Tali preoccupazioni sono emerse con l’invenzione della scrittura (come evidenziato da Platone nel Fedro, 274c - 275b), della stampa, delle tabelle logaritmiche e delle calcolatrici, fino ai moderni computer.

E' interessante ricordare il passo del Fedro, da 274c a 275b, dove Platone, attraverso la voce di Socrate, narra il mito dell’invenzione della scrittura, attribuita al dio egiziano Theuth, e la reazione critica del re Thamus: «O ingegnosissimo Theuth, c'è chi è capace di creare le arti e chi è invece capace di giudicare quale danno o quale vantaggio ne ricaveranno coloro che le adopereranno. Ora tu, essendo padre della scrittura, per affetto hai detto proprio il contrario di quello che essa vale. Infatti, la scoperta della scrittura avrà per effetto di produrre la dimenticanza nelle anime di coloro che la impareranno, perché fidandosi della scrittura si abitueranno a ricordare dal di fuori mediante segni estranei, e non dal di dentro e da se medesimi: dunque, tu hai trovato non il farmaco della memoria, ma del richiamare alla memoria. Della sapienza, poi, tu procuri ai tuoi discepoli l'apparenza e non la verità: infatti essi, divenendo per mezzo tuo uditori di molte cose senza insegnamento, crederanno di essere conoscitori di molte cose, mentre come accade per lo più, in realtà, non le sapranno; e sarà ben difficile discorrere con essi, perché sono diventati portatori di opinioni invece che sapienti» (Platone, Fedro, 274c - 275b, trad. it. Giovanni Reale).

Come abbiamo appena letto, Theuth presenta le lettere come un dono in grado di accrescere la sapienza umana, ma Thamus replica che la scrittura non incrementerà la vera saggezza, bensì offrirà un’illusione di conoscenza e indebolirà la memoria viva degli individui. La diagnosi platonica si articola in due aspetti: da un lato, la scrittura è riconosciuta come strumento utile per la conservazione e la trasmissione delle informazioni; dall’altro, è condannata per la sua capacità di trasformare la conoscenza in qualcosa di esterno e passivo, incapace di insegnare la comprensione critica e la capacità di difendere le proprie conoscenze. In questo contesto, la scrittura genera “ricordi” che non sono veri ricordi interiori e favorisce una fiducia ingannevole nei segni, sostituendo il dialogo vivo e la memoria attiva con un supporto che appare sapere al posto dell’anima. Platone utilizza il mito per sollevare una questione etica e pedagogica: non è sufficiente accumulare tracce esterne di conoscenza; la vera educazione richiede che il soggetto interiorizzi il sapere e sviluppi la capacità di giudicare e argomentare. La critica non rappresenta un rifiuto ingenuo della tecnologia della scrittura, bensì un avvertimento sui rischi che gli strumenti esterni possano soppiantare la formazione della ragione e della memoria attiva, trasformando la sapienza in mera apparenza. Quindi la critica di Platone non è un semplice rifiuto della tecnologia della scrittura, ma un avvertimento sulla sua ambivalenza: essa amplia le possibilità di conservazione e comunicazione, ma può impoverire la memoria e la capacità critica se non viene integrata in una pratica educativa che valorizzi la ragione vivente e il dialogo.

Ritornando ad oggi, è stato dimostrato, per l'appunto, che tali strumenti non determinano di per sé un’atrofia del pensiero, bensì lo elevano giocoforza a un livello superiore, perché hanno aumentato la complessità dei sistemi. Numerosi studi, condotti in ambito educativo e professionale, confermano che l’utilizzo di sistemi di supporto cognitivo contribuiscono a migliorare la qualità delle decisioni, a condizione imprescindibile che l’essere umano mantenga il controllo del problema e dei criteri di valutazione. Al contrario, quando lo strumento viene percepito come un’autorità indiscussa, la qualità delle decisioni subisce un significativo declino e porta a palesi errori di valutazione e di concetto. Insomma, dobbiamo tenere bene a mente, che l’IA si rivela particolarmente efficace solo come “amplificatore” di competenze già esistenti, piuttosto che come surrogato della comprensione umana.

In questo senso, l’Intelligenza Artificiale si presenta più come un telescopio che come un cervello umano. Non sostituisce la visione umana, bensì ne amplia il campo percettivo. Galileo Galilei, ad esempio, non era meno intelligente del suo cannocchiale; anzi, la sua intelligenza risiedeva nella capacità di discernere cosa osservare, cosa trascurare e quando mettere in discussione l’immagine percepita. L’elemento cardine risiede nell’asimmetria: lo strumento è privo di volontà e di fini intrinseci, mentre l’essere umano ne è dotato. Di conseguenza, il significato, il valore e la direzione del pensiero rimangono prerogative umane. L’IA può supportare l’esplorazione dello spazio delle possibilità, ma non può determinare quali di esse meritino di essere perseguite. Tale decisione costituisce un atto squisitamente umano e filosofico, non computazionale. Detto brevemente, il valore intrinseco dato dall'uso dell'Intelligenza Artificiale risiede nel processo di trasformazione: dalla raccolta di dati eterogenei a una forma espressiva dotata di un’intenzionalità precisa. L’Intelligenza Artificiale ottimizza la fase entropica, comprendente la raccolta, il confronto e l’esplorazione di variazioni possibili. Tuttavia, l’atto di deliberare sul contenuto e la motivazione della comunicazione rimane prerogativa umana. È in questo ambito che si configura la responsabilità del pensiero, nonché lo sviluppo dello stile individuale.

Analizziamo sinteticamente alcune applicazioni concrete della distinzione tra mezzi e fini nell’ambito dell’Intelligenza Artificiale.

- Nel contesto dei sistemi di raccomandazione impiegati da numerose piattaforme di streaming e social media, l’algoritmo si prefigge di ottimizzare metriche quali il tempo di permanenza dell’utente o il tasso di clic. In qualità di mezzo, tale algoritmo incrementa l’efficienza nella scoperta di contenuti. Tuttavia, se non adeguatamente regolamentato, esso può assumere la funzione di fine, ridefinendo implicitamente ciò che l’utente percepisce come valore. In questo scenario, la qualità del tempo libero viene quantificata in termini di minuti trascorsi sulla piattaforma, piuttosto che in base al significato o alla crescita personale derivante dall’esperienza. Tale spostamento evidenzia come un mezzo altamente efficace possa trasformarsi in un criterio di valutazione se gli obiettivi finali non vengono esplicitati e difesi con chiarezza.

- Gli strumenti di scrittura assistita, che spaziano dai correttori ortografici avanzati ai generatori di testi, rappresentano un ulteriore caso di studio. In qualità di mezzo, tali strumenti accelerano il processo di produzione testuale, supportano l’autore nel superamento di blocchi creativi e contribuiscono al miglioramento della qualità formale del testo. Come fine, tuttavia, essi possono indurre una delega della capacità critica dell’utente. L’autore, infatti, rischia di accettare soluzioni preconfezionate senza un’adeguata riflessione sui fini comunicativi, sulla responsabilità retorica e sull’originalità del proprio lavoro. In questo caso, la perdita non si limita al piano tecnico, ma si estende anche a quello formativo, indebolendo l’abitudine a pensare in modo critico e a formulare giudizi autonomi.

- Nel campo della diagnostica medica basata su modelli predittivi, l’Intelligenza Artificiale offre il potenziale di aumentare significativamente la precisione delle diagnosi e di ridurre il margine di errore umano. In qualità di mezzo, tali tecnologie contribuiscono a salvare vite umane e a ottimizzare l’allocazione delle risorse sanitarie. Come fine, tuttavia, se le decisioni cliniche vengono subordinate in modo acritico al verdetto algoritmico, si pone a serio rischio l’autonomia del medico e la qualità della relazione terapeutica. La tecnologia, in questo caso, può assumere il ruolo di un’autorità esterna, determinando le priorità di cura, l’allocazione delle risorse e persino la definizione di concetti quali la normalità.

Si possono formulare almeno due obiezioni rilevanti in merito all’impatto dell’Intelligenza Artificiale sull’autonomia umana. La prima obiezione sostiene che l’IA non necessariamente compromette l’autonomia, bensì può potenziarla. L’automazione di compiti ripetitivi libera risorse cognitive per attività creative e deliberative, mentre l’accesso a informazioni più complete potenzia la capacità decisionale dell’agente. La seconda obiezione si riferisce alla pratica nota come human-in-the-loop, un termine inglese che indica sistemi progettati per integrare il giudizio umano nelle fasi critiche del processo decisionale. In altre parole, non si tratta di sostituire l’essere umano, ma di prevedere un “anello” in cui l’uomo verifica, corregge e approva le conclusioni algoritmiche. Queste obiezioni non esauriscono la complessità del problema. L’ampliamento dell’autonomia non è un risultato automatico, bensì dipende da scelte progettuali, istituzionali e culturali. Se la progettazione privilegia esclusivamente metriche di efficienza – termine che in questo contesto indica indicatori misurabili utilizzati per valutare le prestazioni del sistema – l’apparente liberazione può trasformarsi in una pressione a massimizzare tali metriche, impoverendo i fini ultimi. Per quanto riguarda la soluzione human-in-the-loop, essa rimane necessaria ma non sufficiente. Affinché funzioni efficacemente, è essenziale che gli attori umani siano adeguatamente formati, responsabilizzati e dotati di poteri effettivi di intervento. Se il loop umano è solo nominale, ovvero un controllo formale e superficiale su decisioni già prese dall’algoritmo, la funzione di garanzia fallisce.

Per evitare che i mezzi impongano i fini, servono tre condizioni interconnesse. Innanzitutto, la progettazione normativa: l’integrazione fin dall’inizio di criteri etici e finalità esplicite nei requisiti di sistema, non come semplice addendum. Un addendum è un’aggiunta posteriore, un elemento accessorio che non vincola il progetto principale. Il suggerimento è di renderlo un vero vincolo progettuale, una regola obbligatoria che orienta le scelte tecniche. In secondo luogo, formazione e responsabilità: la formazione degli operatori a comprendere e valutare i sistemi, e la loro responsabilità nel rendere conto pubblicamente delle decisioni finali. Gli operatori devono saper interrogare i risultati algoritmici, esaminandoli criticamente, verificandone limiti e presupposti, e non accettandoli come verità incontestabili. Infine, la trasparenza istituzionale, che richiede procedure di accountability, ossia un sistema di responsabilità e rendicontazione che rende visibili le scelte compiute, le metriche perseguite e i trade-off, ovvero i compromessi impliciti tra obiettivi diversi. Solo così il dibattito pubblico può valutare i fini sociali che la tecnologia serve e impedire che siano i mezzi a definire da soli ciò che conta.

La distinzione tra mezzi e fini non può che farci pensare alle ricadute etiche, per le quali mi rifaccio al pensiero di Kant, dove il vero rischio non nasce dalla tecnica in sé, ma dal modo in cui la si colloca nella gerarchia dei valori. L’errore decisivo, per Kant, è scambiare ciò che serve a qualcos’altro con ciò che invece possiede valore per se stesso. Nella «Critica della ragion pratica» (1788) e, ancor più nettamente, nella «Fondazione della metafisica dei costumi» (1785), Kant traccia una distinzione netta: ciò che ha un prezzo può essere rimpiazzato; ciò che ha dignità, no. I mezzi appartengono alla prima categoria, i fini morali alla seconda. L’Intelligenza Artificiale si inserisce esattamente in questo quadro: è uno strumento potentissimo, ma rimane pur sempre uno strumento, un mezzo. Attribuirle lo statuto di fine – considerarla un’autorità conoscitiva, un garante della verità, o un sostituto del pensiero – significa cadere nell’eteronomia, cioè rinunciare alla propria autonomia per lasciarsi guidare da qualcosa di esterno, anche quando questo “esterno” assume la forma di una macchina sofisticata.

C’è poi un aspetto meno discusso ma decisivo: per Kant, la ragione è anzitutto pratica. Il suo compito primario non è descrivere il mondo, bensì orientare l’azione verso fini che possano valere universalmente. Un sistema artificiale, per quanto efficiente nell’ottimizzare i mezzi, non può rispondere alla domanda che per Kant è centrale: "Che cosa devo volere"? Può imitare una risposta, ma non farla propria. Il pericolo, dunque, non è che l’IA diventi troppo potente, bensì che l’essere umano smetta di interrogarsi sui fini e si limiti a lasciarsi trascinare dall’efficacia dei mezzi.

Quando i fini si indeboliscono, infatti, i mezzi tendono a imporsi da soli: sono più semplici, più rapidi, più misurabili. Kant lo aveva già intravisto: la razionalità strumentale seduce proprio perché sembra neutrale. In questo senso, ogni uso dell’IA ci pone una domanda implicita: "Sto davvero impiegando questo strumento, o sto permettendo che sia lui a decidere che cosa conta"? È una questione che non si risolve sul piano tecnico, ma su quello morale.

Concludo ricordando i contenuti de' «La Fondazione della metafisica dei costumi». Essa si presenta come un’indagine approfondita sulle condizioni formali della moralità. Kant non si prefigge di individuare regole empiriche o fornire consigli pratici, bensì di delineare la forma pura del dovere, ovvero ciò che conferisce a un’azione un valore morale intrinseco, indipendentemente dalle sue conseguenze contingenti. L’opera si articola in tre fasi che guidano la ragione dal senso comune morale alla formulazione di un principio etico universale, dimostrando come la moralità non derivi né da inclinazioni personali né da calcoli strumentali, ma da una legge che la ragione stessa si impone. Al centro di tale riflessione si pone la nozione di buona volontà: essa rappresenta l’unico bene incondizionato, il valore che non è subordinato a fattori esterni quali fortuna, abilità o risultati. Kant opera una distinzione netta tra azioni conformi al dovere e azioni compiute per dovere; solo quando l’azione è motivata dal rispetto per la legge morale essa acquisisce un valore morale. La dignità della persona emerge in questo contesto quale principio pratico: gli esseri razionali non devono mai essere considerati meri mezzi, bensì fini in sé, e la moralità consiste nel trattare ogni agente come portatore di valore intrinseco.

Per esprimere la legge morale, Kant introduce l’imperativo categorico, formulato in diverse modalità che risultano logicamente equivalenti:

- agire esclusivamente secondo quella massima che si può volere diventi legge universale;

- trattare l’umanità sempre come fine e mai come mezzo;

- agire come se la propria massima dovesse servire da principio legislativo in un regno dei fini.

Tali formulazioni non costituiscono mere astrazioni retoriche, bensì criteri operativi per valutare come rendere universali e rispettabili le massime: un principio che non può essere coerentemente voluto come legge universale è contraddittorio nella volontà e, pertanto, immorale. Secondo Kant, il dovere si configura come la necessità di un’azione dettata dal rispetto per la legge. È la legge, in quanto sovrastante tutte le inclinazioni personali, a costituire l’unico oggetto di rispetto. Pertanto, la volontà è determinata, in maniera oggettiva, dalla legge stessa e, in maniera soggettiva, dal puro rispetto che essa ispira. La rappresentazione della legge, che si manifesta esclusivamente nell’essere razionale, determina la volontà. Ci si interroga, dunque, sulla natura di questa legge. Kant afferma: “Non devo comportarmi se non in modo che io possa anche volere che la mia massima debba diventare una legge universale”. Un’azione, pertanto, si configura come moralmente buona se supera il criterio dell’universalizzazione.

La tesi fondamentale della Fondazione è che la moralità si configura come autonomia: la legge morale non origina da fonti esterne né da impulsi sensoriali, bensì dalla ragione pratica che si auto-legifera. Tale autonomia si contrappone all’eteronomia, in cui la volontà è condizionata da fattori esterni; la vera etica kantiana impone all’agente il riconoscimento e l’osservanza della propria legislazione razionale. Da questa premessa derivano implicazioni concrete per la valutazione morale: la determinazione della correttezza di un’azione non può limitarsi a un calcolo utilitaristico, poiché la dignità e il rispetto per l’individuo impongono vincoli ai mezzi e fondano diritti e doveri universali.

In sintesi, la Fondazione si propone di fornire una base metafisica per l’etica, dimostrando come la legge morale si configuri come un principio formale, a priori, che orienta l’azione umana verso fini universalizzabili senza contraddizione, e che attribuisce all’individuo una dignità inalienabile, precludendo la sua riduzione a semplice strumento.

Riferimenti Bibliografici

- Platone. (2000). Fedro (G. Reale, Trad.). Bompiani.

- Galilei, G. (1993). Sidereus Nuncius (A. Battistini, Trad.). Marsilio. (Opera originale pubblicata 1610).

- Kant, I. (2001). Critica della ragion pratica (P. Chiodi, Trad.). Laterza. (Opera originale pubblicata 1788).

- Kant, I. (2005). Fondazione della metafisica dei costumi (P. Chiodi, Trad.). Laterza. (Opera originale pubblicata 1785).

- Ruffa, G. (2025). La nulla Scienza: Aforismi per chi ha smesso di cercare perché ha già trovato il nulla. Amazon Independently Published.

— — — — — — — — — — — — — — — — — — — — — — —

Pubblicazioni recenti:

Giorgio Ruffa, La nulla Scienza: Aforismi per chi ha smesso di cercare perché ha già trovato il nulla, 2025.

Disponibile su Amazon: https://amzn.eu/d/0dupI2zK

English

English

Français

Français

Deutsch

Deutsch

Italiano

Italiano

Español

Español

Contribuisci

Contribuisci

Cultura

Cultura

Puoi sostenere i tuoi scrittori preferiti

Puoi sostenere i tuoi scrittori preferiti

Commento (0)